シンクロ率100%の分身ロボットはすぐそこに。「触覚」の伝送技術で拓く「行動のインターネット」化(BUSINESS INSIDER JAPAN)

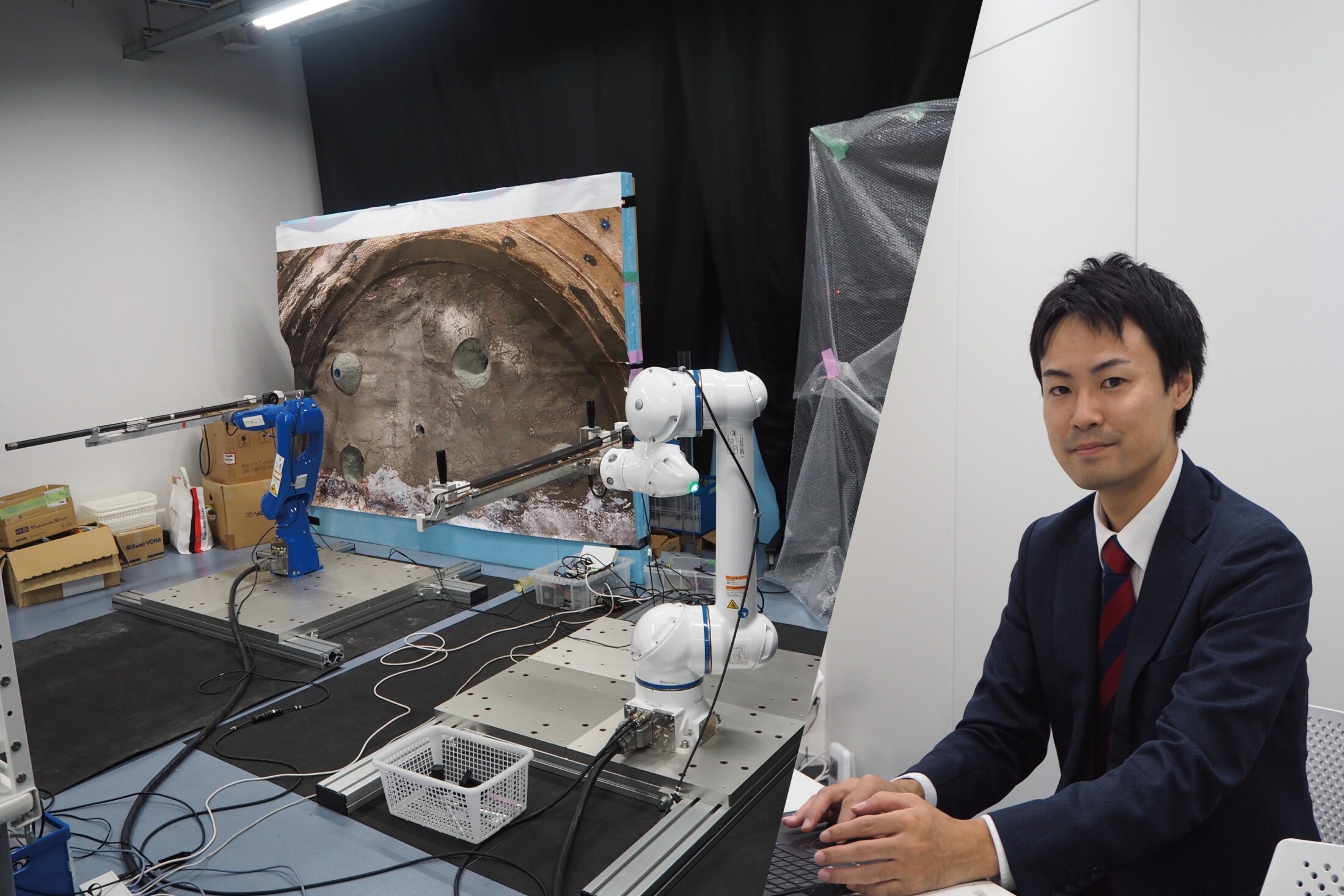

人間の動きにシンクロし、手足のように動くロボットを操作する──そんなSF漫画やアニメで描かれていた光景が、現実のものになりつつある。 【全画像をみる】シンクロ率100%の分身ロボットはすぐそこに。「触覚」の伝送技術で拓く「行動のインターネット」化 2024年12月、大手ゼネコンの大林組は、「リアルハプティクス」という技術を応用した遠隔操作ロボットによって、山岳トンネルでの火薬装填・発破作業を行う実証実験に成功したと発表した。この共同研究を率いたのは、慶應義塾大学の野崎貴裕准教授らの研究チームだ。 「文章や画像、音声や動画という視覚的、聴覚的な情報をデジタルでやり取りするのが今や当たり前になったように、私は“触覚”もやり取りする未来が来ると確信しています」(野崎氏) そう語る野崎准教授は、動作の記録・保存・共有が可能となる「IoA(Internet of Action:行動のインターネット)」という概念を提唱している。これは人間の行動そのものをデジタル化し、ロボットと双方向に伝送することを通じて、建設、医療、製造といった産業の課題を解決するのみならず、働き方や生活を大きく変えうるものだ。

人間は世界を五感を通じて知覚しているが、何か作業を行う際に不可欠となるのは、「見る(視覚)」「聞く(聴覚)」「触る(触覚)」の三つの感覚だ。ウェブ会議や動画配信サービスの浸透を見ればわかる通り、すでに視覚と聴覚の情報は巨大なマーケットを形成している。野崎准教授が着目するのは、最後に残された「触覚」の重要性だ。 「視覚や聴覚は受動的な感覚です。目の前の物をどれだけ見つめ、耳を傾けても、状況は変えられません。一方で、触覚を用いてそれをつかみ、動かせば、変化を起こせる。触覚は人間の感覚のうち、外界の状況を変えられる唯一の能動的な手段なのです」(野崎氏) 野崎准教授が専門とする「リアルハプティクス」とは、ロボットの力加減を制御する技術だ。 考えてみてほしい。卵を運ぶときは、誰でもそっと優しく手に取る。一方で、同じような大きさでも、じゃがいもをつかむときにはそこまで気をつかわない。このように、人間は物をつかむ瞬間、無意識のうちに位置と硬さ/柔らかさを調整している。 当たり前の話だが、実はこれを従来のロボットで再現することは相当に難しい。これまでの一般的なロボットでは、あらかじめ設定した力でしか物をつかむことができなかった。それがリアルハプティクス技術を用いれば、この位置と力の統合制御をリアルタイムかつ滑らかに行える。人間の手に近いしなやかな動きを実現できるのだ。 この技術を使えば、遠隔操作する作業用ロボットの「触覚情報」を、遠く離れた場所にいる操作者にフィードバックすることもできる。例えば、スポンジに触れれば「ポヨンとした柔らかい感覚」が、アルミブロックに触れれば「カツンとした硬い感覚」が、そのまま手元に返ってくる。 リアルハプティックスによるロボット操作では、モーターが指令された場所にピタッと動くと同時に、オペレーターの力加減を忠実に再現することが不可欠だ。ここが少しでもズレてしまえば、途端に「違和感」が生まれてしまう。この高精度な同期と低遅延は、いくらコンピュータの処理能力やカメラ精度を高めても実現できない。 電気を適切に制御・変換する技術が欠かせないが、これがロボット開発の主流である機械工学や情報科学ではなく、もともと「電気」を専門としている野崎准教授だからこそ開発できる理由にもなっている。 「ロボットを動かすというのは、突き詰めればモーターを動かすことです。モーターは電気で動く。電気を専門とする人間がロボット開発を行うと、他のロボット開発者にはない発想や、実現できなかった制御が可能になることがあります」(野崎氏)