みんなこれでいいAI。Googleの最新ローカルLLM「Gemma 4」は日本語うますぎ、でも無料

「これが無料でいいの?」ってレベル。

2026年4月にGoogleが新しいローカルLLM「Gemma 4」シリーズをリリースしました。Gemma 4シリーズは前世代から大きく性能・機能が向上し、現在、非常に高い評価を得ています。

実際に利用してみましたが、日本語能力が高く、挙動にも癖がありません。扱いやすいローカルLLMでした。一般的なノートPC向けのバージョンからハイエンドマシン向けの高性能モデルまでが揃っており、ニーズに合わせて選べるのも嬉しい。

これからローカルLLMを始める人から、既に触っている人まで、ほとんどあらゆる人におすすめできます。以下、どのようなAIなのか・何をどの程度できるのかをまとめます。

Gemma 4はどんなローカルLLMなの?

Gemma 4シリーズのロゴImage: Google前述のように、2026年4月にリリースされたGoogleのローカルLLMシリーズで、専用ソフトなどから無料でダウンロードして利用できます。

Gemma 4シリーズは4つのAIモデルで構成されています。以下それぞれ「E2B」「E4B」「26B-A4B」「31B」と表記します。

Gemma 4シリーズは動作デバイスと性能の観点から、2種に分類できます。

・E2B・E4B:普通のノートPCで動かせる軽量モデル

・26B-A4B:ハイエンドマシンで動かす高性能モデル

いずれも非常に実用性が高いモデルとなっており、とりあえず動かせるものを選べばOKです。

Apache 2.0ライセンスで提供されており、個人利用はもちろんのこと、商用での利用も可能です。

専門サイトによる評価も高い

「Gemini 3の研究・技術に基づいてローカルLLMの限界を引き上げるようにGemma 4を開発した」とGoogleは述べていますが、これは煽り文句ではありません。

AI評価サイト「Arena.ai」における一部ローカルLLMの性能評価グラフ。gemma-4-31B・gemma-4-26B-A4Bはサイズに対する評価が高くなっているImage: GoogleAI評価サイト「Arena.ai」では、サイズで上回る(≒基本的にはより性能がよいはずの)モデルと比べても良い評価を得ており、実際に使ってみてもそのような印象です。

別のAI評価サイト「Artificial Analysis」が実施した独自ベンチマークでは、前世代のGemma 3シリーズから大きくスコアを伸ばしています。

Google has released Gemma 4, four open weights models with multimodality support. The flagship 31B model (39 on the Intelligence Index) uses ~2.5x fewer output tokens than Qwen3.5 27B (Reasoning, 42) but trails it by 3 points on intelligence@GoogleDeepMind's Gemma 4 includes… pic.twitter.com/4UXvGh3Y0S

— Artificial Analysis (@ArtificialAnlys) April 4, 2026

E4Bは、2025年度リリースでロングテールで用いられている「openai/gpt-oss-20b」に迫る総合スコアを獲得しています。gpt-oss-20bはゲーミングPCなどで動かすやや重いモデルであるのに対し、E4BはMacBook Airで動作します。

E2Bにはわかりやすい比較対象がありませんが、スコアが大きく伸びているのは同様です。

高性能モデル2種も優れた結果を残しています。

26B-E4Bはgpt-oss-20bのようにゲーミングPCなどで動かすサイズ感のモデルですが、その総合スコアはより重たいopenai/gpt-oss-120bと同ランクです。

31Bはgpt-oss-120bと同程度の重さのモデルですが、総合スコアでは上回っています。

すべてのモデルがサイズの壁を打ち破るような進化を果たしており、そのレベルは「近いサイズの優秀な2025年モデル」を1〜2段上回る、といった感じになっています。

2026年リリースのローカルLLMでも特に優秀なQwen3.5シリーズとともに「今年のローカルLLMのベンチマーク」になるような、ハイレベルなモデルシリーズだと言えます。

Gemma 4シリーズでは何ができるの?

以下、Gemma 4シリーズがどのような機能・性能を備えているかを紹介します。自分が実際に動作させての印象をベースにしていますが、動作環境が異なれば印象も変わってくる可能性があります。この点はご了承ください。

動作環境は以下になります。動作はLM Studio上で行い、GX10利用時はLM Linkでリモート接続して推論させています。

・E2BおよびE4B:MacBook Pro(2025年モデル, M4, メモリ16GB)

・26B-A4Bおよび31B:Asus GX10(2025年モデル, GB10, メモリ128GB)

ご自身の環境で動作するかを確認したい場合は、スペックに対して動くモデルを確認できるサイト「Can I Run AI locally?」を参照するのがおすすめです。

1. 推論:要約やアイデア出し、翻訳にも向く

gemma-4-E4Bで英語の文章を日本語に翻訳したところ。軽量モデルでも十分に読みやすい日本語訳を生成できる。原文はこちらImage: かみやまたくみAIの基本である推論を高水準にこなせるため、要約やアイデア出しに使えます。コード生成も可能ですが、これについては後述します。

見どころは、日本語能力がかなり進化していること。英語の資料に対して日本語で質問すると、あたかも元々日本語であったかのように自然な表現で内容を教えてくれます。英語を日本語にするのも、その逆もどちらも余裕です。翻訳者というか、文章で返してくる通訳って感覚です。

モデルが重いほうがこなれた日本語を書く印象ですが、最軽量のE2Bでも専門的な文章でない限りはだいたい問題ないはずです。

2. 画像認識:「画像の言語化」ができる

Gemma 4シリーズはすべて画像認識に対応しており、以下のように活用できます。

・被写体の認識と言語化(写真に写っているものを説明させる)

・AI OCR(画像内に含まれているテキストを書き起こさせる)

自分が試したところ、モデルごとの性能差が顕著で、「このモデルなら正確にできる」「このモデルだと変な結果が出る」というのが明確にありました。

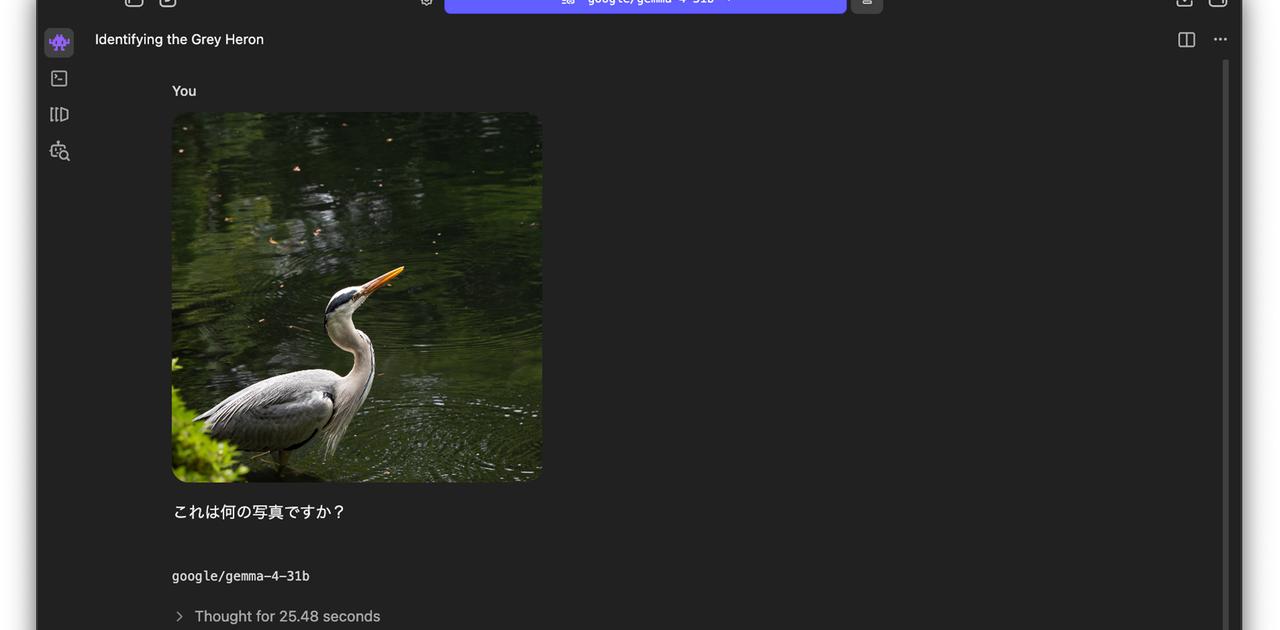

(a) 被写体認識:26B A4B・31Bなら実用的

gemma-4-E4Bで写真に写っているものを言語的に表現させたところ。家系ラーメンが写っているが、「日本の麺類」と表現したImage: かみやまたくみ家系ラーメンの写真をE4Bに認識させたところ、「日本の麺類」と認識・回答しました。

gemma-4-26B-A4Bで写真に写っているものを言語的に表現させたところ。きちんとラーメンだと認識しているImage: かみやまたくみ対して26B-A4Bは、きちんと「ラーメン」と認識しています。31Bも同様でした。

いずれも「人間レベル」ではないのには注意が必要です。

たとえば、31Bは「豚骨か鶏白湯のどっちか」と推定しましたが、正解は「横浜家系ラーメン」。動植物の学名などを正確に出すのも難しそうでした。特にディテールの認識が人間レベルでない印象です。

トータルで見ると、「ブログやSNS用の画像にキャプションをつけるとかには使える」といったイメージになります。Pythonスクリプトなどから呼び出せば、大量の画像にキャプションをつけたりできるので、思った以上に使えます。

(b) AI OCR:E4B以上は高精度に行える

gemma-4-E4BにWebページのスクリーンショットを渡し、文字起こしさせたところ。E4B・26B A4B・31Bに関してはかなり正確に書き起こせるImage: かみやまたくみ文字起こしについては「E4B以上」であれば実用的、という印象でした。概ね正確に、与えられた画像の文字を書き起こせます。コピペが難しいサイトや紙の資料のテキスト化に使えると思います。

E2Bのみ、書かれているのとはまったく異なる文章を返してきました。うまくいくこともなくはありませんでしたが、安定はしませんでした。

ただ、どのモデルでも100%正確ではない場合があり、また画像内の文字の読み取りやすさなども品質に影響することがあります。

3. MCPの実行:「ネットへのアクセス」をうまく使える

gemma-4-E4Bに「URLにアクセスして本文を取得するMCP」を利用して要約を行わせているところImage: かみやまたくみGemma 4シリーズは「ツール利用」に対応しており、MCP(超絶ハイパーざっくり言うと「AI用に書かれたプログラム」)を運用できます。モデル単体では取得できないネットの最新知識を使った推論ができますよ。

すべてのモデルがMCPを扱えますが、E2Bは理解が浅く、失敗することもありました。E4Bだと一気に失敗が減り、26B-A4B・31Bはほぼ失敗しませんでした。

31Bは推論能力が非常に高く、使ったMCPの問題点・改善点を適切に指摘することさえできました。MCPの開発パートナーとして使える水準かと思います。

E4BもきちんとしたMCPを用意できるならおすすめできます。軽いため、爆速で処理が完了します。ローカルMCPとは特に相性がいいです。

4. コード生成と実行:長時間の「複雑な思考」に対応

E4Bは簡単なコードの生成が可能です。指示の出し方にもよりますが、それなりに1発で動くものを生成できます。コーディングアシスタントとして使えなくもない、という印象です。

Gemma 4 26B A4Bを使って作った「簡易神経衰弱」。24枚のカードをペアになるように、カードがすべてなくなるまでめくっていく。カードをランダムに配置する・ユーザーの手番が終わったらCPUがカードをめくるといった動きを300行ほどのコードで実現しているImage: かみやまたくみ本格的に使うのであれば、26B-A4B・31Bはおすすめできます。相当な水準です。

オープンソースのAIコーディングエージェント「OpenCode」を用いてゲームを生成させたところ、エラーが出て修正のための会話を2回ほど行う必要があったものの、動くゲームを完成させられました。詳しくはこちらの記事をご覧ください。

GPT-5.5やOpus 4.7などの最新モデルには及びませんが、AGENTS.mdをきちんと理解し、完成まで粘り強く思考します。業務レベルの内容は厳しいかもしれませんが、個人開発レベルであれば実用も可能な水準だと思います。

Source: Google, Hugging Face, Artificial Analysis