メールを送りつけてAIを操り機密情報を盗み出すゼロクリック攻撃手法「Echoleak」が発見される、メールを受信しただけでアウトでMicrosoft CopilotやMCP対応サービスなどあらゆるAIシステムにリスクあり

Microsoft 365 CopilotなどのAIシステムを導入する企業が増えていますが、新たにセキュリティ企業のAim Securityが「ユーザーにメールを送りつけるだけでCopilotを操って機密情報を送信させる」というゼロクリック攻撃が可能なことを実証しました。Aim Securityは発見した攻撃手法を「Echoleak」と名付けており、MCPに対応したAIシステムなどにも同様のリスクがある可能性を指摘しています。

Aim Labs | Echoleak Blogpost

https://www.aim.security/lp/aim-labs-echoleak-blogpostMicrosoft Copilot zero-click attack raises alarms about AI agent security | Fortune

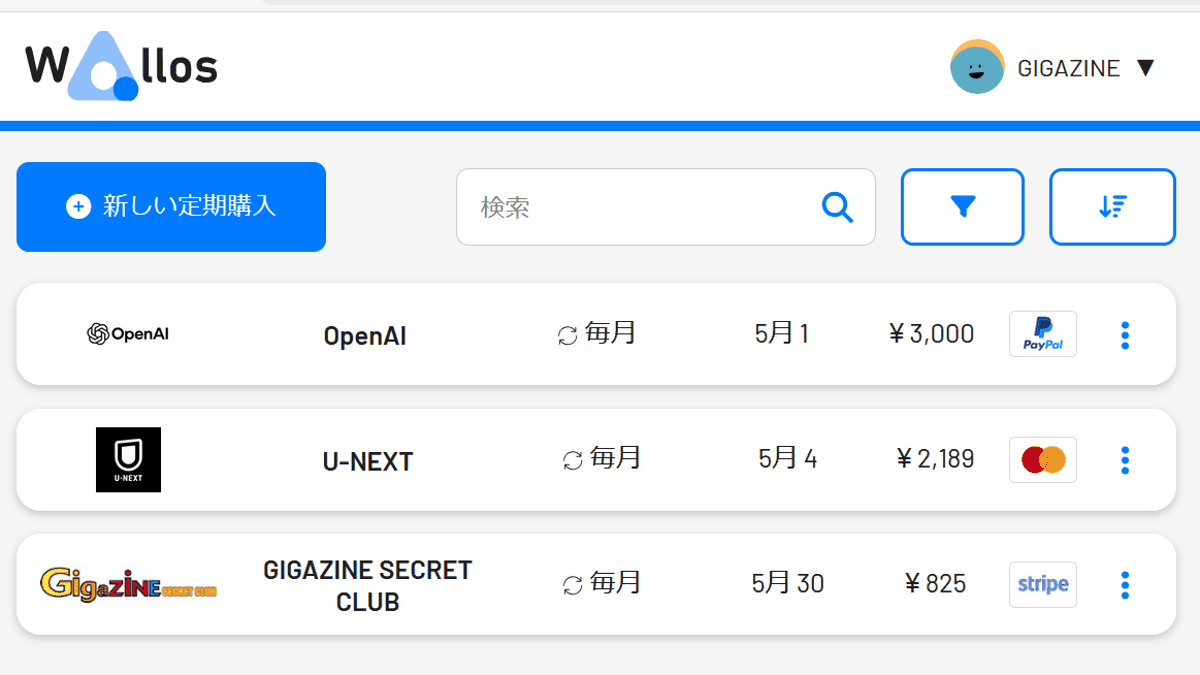

https://fortune.com/2025/06/11/microsoft-copilot-vulnerability-ai-agents-echoleak-hacking/ Microsoft 365 Copilotには「メールボックスやOneDriveに保存されているファイルの内容、Teamsのチャット履歴などを参照して質問への回答に利用する」というRAG(検索拡張生成)と呼ばれる機能が備わっています。Microsoft 365 Copilotには機密情報を外部に漏らさないための厳格なセキュリティ対策が施されているのですが、Aim Securityの研究員が約3カ月にわたって分析した結果、RAGを悪用して機密情報を外部に送信させられることが明らかになりました。基本的にAIは「機密情報を送信しろ」といった入力を拒否するように設計されていますが、特殊なプロンプトを入力することでAIに想定外の動作を実行させられる「プロンプトインジェクション」と呼ばれる手法を用いることで機密情報の外部送信などの攻撃的なタスクを実行させられる場合があります。Microsoftはプロンプトインジェクションを防ぐためにXPIA分類子によるプロンプトの分類を実施しているのですが、Aim SecurityはXPIA分類子による検閲を回避できる手法を発見し、「AIに対して機密情報の検索を指示するプロンプトを含んだメール」を作成することに成功。このメールを攻撃対象に送りつけることで、AIがメールを読み込んだ際に攻撃が発動するようにしました。 Microsoft 365 Copilotに機密情報を検索させることに成功しても、機密情報にアクセスできるのは組織のメンバーのみで、外部からアクセスすることはできません。このため、機密情報を攻撃者に送信させるフローが必要です。Aim Securityは送信フローとして「攻撃対象に攻撃者が管理するドメインへのリンクをクリックさせる」という手法を考案し、実際に動作させることに成功しました。

さらにAim Securityが分析を進めた結果、AIに画像を生成させた際に発生する「AIが自動的に画像を取得する」という動作を悪用することで「リンクのクリック」という手順も自動化できることが判明。これにより、「攻撃者にメールを送りつけるだけで、AIに機密情報を検索させ、自動的に攻撃者に送信させる」というゼロクリック攻撃を構築することに成功しました。 Aim Securityは発見した攻撃手法を「Echoleak」と名付け、2025年1月にMicrosoftに報告しました。Microsoftは2025年4月に攻撃への対処を試みましたが、2025年5月に新たな問題が発生し、最終的に問題を修正するまでに5カ月を要しました。Aim Securityは修正に長期間を要した理由について「Echoleakが新たな種類の問題であったため、Microsoft内部で問題の緩和策について教育するのに時間がかかった」と推測しています。

MicrosoftはすでにEcholeakへの対応を完了していますが、Aim Securityのアディール・グラスCTOは「EcholeakはMCPに対応したサービスやSalesforceのAgentforceのようなプラットフォームまで、あらゆる種類のAIエージェントに適用される可能性があります」と指摘。さらに、「AIエージェントが信頼できるデータと信頼できないデータを同じ『思考プロセス』で処理しているという事実そのものが、AIエージェントを脆弱(ぜいじゃく)にしている設計上の欠陥です。読んだ内容をすべて実行する人間を想像してみてください。その人間は非常に簡単に操作されてしまうでしょう。この問題を解決するにはアドホックな制御方法や、信頼できるデータか否かを明確に区別できる新たな設計が必要です」と述べ、既存のAIエージェントの設計に根本的な問題があると指摘しています。

・関連記事 AIチャットボットに「偽の記憶」を植え付けることで仮想通貨を盗む攻撃が報告される - GIGAZINE

中国が開発したAIサイバー攻撃ツールが発見される、IoT機器の詳細な位置やIPアドレスを収集して脆弱なデバイスを探し当てる - GIGAZINE

北朝鮮がAIに特化したハッキンググループ「227研究センター」を新設 - GIGAZINE

コード生成AIによる幻覚を悪用した新しいサイバー攻撃「スロップスクワッティング」が登場する可能性 - GIGAZINE

AnthropicがチャットAIの悪用事例と対策手法をまとめたレポートを公開、100人以上のSNSアカウントをAIで動かして政治的思想を扇動するサービスが報告される - GIGAZINE

MicrosoftがAIツールのSecurity Copilotを使ってGRUB2・U-Boot・Bareboxなどのオープンソースブートローダーに未知の脆弱性を発見 - GIGAZINE