「MPCサーバー」でローカルLLMを“無料AIエージェント”に変えてみる

無料ダウンロードして使えるAI「ローカルLLM」が2026年に入ってものすごい勢いで高性能になっています。

自分はAIコストを圧縮できないかなと思っていろいろと試しているのですが、最近よく使うようになった機能があります。

それが「MCPサーバー」。さまざまな情報を取得・生成できるようになるAI用の拡張機能です。昨今のローカルLLMはそれらを上手に使いこなせるようになっているのです。

まだ導入や設定の敷居が高く、リスクもあるので万人におすすめはできないのですが、その辺り理解して使えるのであれば非常に有用だと感じます。

せっかくなのでどんなことができて、何が便利なのかを紹介してみましょう。

MCPサーバーって何?

MCPサーバーはAI用の拡張機能と考えると理解しやすいです。

ニュースアプリを使えば、新しいニュースを読めますが、AIは人間用のアプリをそのまま使うことはできません。でもAIにも最新の情報を知って回答を生成させたい。

MCPサーバーはそういったときに利用する特殊なプログラムです。

例1:PC上のファイルを読み書きさせられる

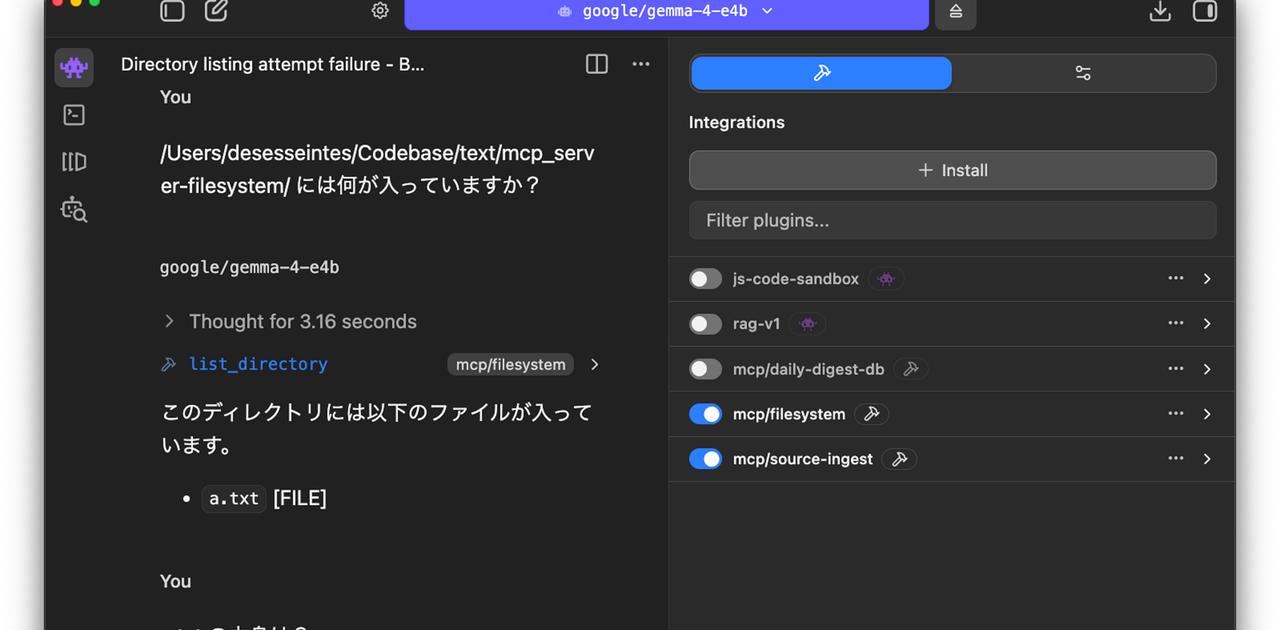

実際にどんなものなのか、もっとも基本的なMCPサーバー「Filesystem MCP Server」を使ってお見せします。

ローカルLLMに生成を行わせ、それを直接ファイルに保存しているところ。利用しているMCPは「Filesystem MCP Server」Image: かみやまたくみ上掲の画像では、ローカルLLMアプリ「LM Studio」にこのMCPサーバーをインストールし、ローカルLLMに詩を書かせ、ファイルとしてPC上に保存させています。新しいファイルを作成しているんです。

MCPサーバーは、AIに何らかの能力を与えます。Filesystem MCP Serverの場合はPC内のファイルを読み書きする能力がAIに付与されます。

次の例も見てみましょう。

Filesystem MCP Serverを用いて既存のファイルを読み込み、その内容を元にローカルLLMに生成を行わせているところImage: かみやまたくみこちらの画像は、同じMCPサーバーを用いて、保存したファイルを読み取り、その内容を日本語に翻訳させているところです。

普通はフォルダを開いてファイルを選んで読み込ませるとかそういう感じになりますが、Filesystem MCP Serverを使うとそれがチャットでできるようになります。ファイル検索なども可能ですよ。

これはChatGPTやGeminiにはない機能な一方で、Claude CodeやCodexのような昨今話題になりがちなAIエージェントアプリでは標準搭載されています。ローカルLLMをそういったより高度なAIツールの仕様に近づけることができるわけです。

例2:Webページを読み取る能力を与えられる

これだけだとちょっと物足りないですよね。というわけで、別のMCPサーバーを組み合わせてもっと発展的に使っているところをお見せします。

自作MCPでWebページの内容を取得し、Filesystem MCP Serverでファイルに保存しているところImage: かみやまたくみこちらの画像は、指定したWebページにアクセスして読み取るMCPサーバーをFilesystem MCP Serverと併用して、読み取った内容をPC上に保存しているところです。気になったページを参考資料として残す作業をやってもらっている感じですね。ファイル名をAIにつけてもらえるのが地味に楽です。

ローカルLLMがチャットボットからAIエージェントに進化する

国土交通省が開発・公開している「地理空間MCP Server」では不動産取引データを取得し、AIに分析させることができるImage: 国土交通省このようにMCPサーバーの中にはWebの情報を取得する能力を付与するものがあります。たとえば、国土交通省は「地理空間MCP Server」を公開しており、これを利用すると不動産取引データ(地価情報など)を取得できます。ネット上の公開データを使って分析レポートを書かせて保存、といったことができるということです。

MCPサーバーには本当にさまざまなものがあります。たとえば、draw.ioの公式MCPサーバーでは概念図を描いてもらえたりします。特定の生成能力を付与するようなものもあります。

Filesystem MCP Serverのような基礎的な能力を与えるMCPサーバーと、地理空間MCP Serverやdraw.io MCPのような拡張的なMCPサーバーを組み合わせることで、ローカルLLMを単なるチャットボットからAIエージェントに進化させられるようになっています。

ローカルLLM×MCPサーバーを使ううえでの注意点

残念ながら現時点でのMCPサーバーは、万人向けではありません。ローカルLLMそのものにもそういう面がありますが、MCPサーバーもまた「何かあっても自己責任」です。

現状だとPC慣れしていて、かつLM Studioや各MCPサーバーの公式ドキュメントをきちんと読める人ならトライしてみてもいいかな、くらいの立ち位置かなと思います。

1. 設定がけっこうムズい

LM StudioのMCPサーバー設定画面。コマンドラインからMCPサーバーをインストールし、JSON形式で設定ファイルに記載する。ぶっちゃけ敷居は高いImage: かみやまたくみこちらはLM StudioのMCPサーバー設定画面です。画面というか、設定ファイルを開いてユーザーが必要な設定を記述します。どう書くかなどを理解している必要がある…と言えば、めんどくささは伝わるのではないでしょうか。

2. インストールの敷居も高い

Filesystem MCP ServerをMacにインストールするには、ターミナルアプリを開いてコマンドを打ち込む必要があるImage: かみやまたくみMCPサーバーは普通のアプリではなく、インストールはコマンドを使ってターミナルから行います。

ネットで調べればやり方自体はわかりますが、そんなのやったことないよ!という方のほうが多いであろうこのご時世にそんな感じです。

3. 「信頼できるMCPサーバー」を選ぶ必要もある

また、MCPサーバーの選定も大変です。既にさまざまなMCPサーバーが公開されていますが、悪意のあるコードが混入している可能性がない、信頼できるMCPサーバーを選ぶべきです。

たとえば、本稿で紹介したFilesystem MCP ServerはMCP規格の開発元が公開しているもので、非常に信頼性の高いものです。国土交通省による地理空間MCP Serverも、多くの企業・エンジニアが利用するツールのMCP版であるdraw.io MCPについても同様です。

この「信頼できる」という条件はわりとキツく、いいのがないなぁ…となることも多々あります。具体例2で使ったWebページを取得するMCPサーバーはいいものが見つからず、自作したものです。

AIに助けてもらえば導入可能ではある

そんなわけでローカルLLMをMCPサーバーを使ってAIエージェント化するのは、残念ながらまだあまりカンタンではありません。

それでも興味があるなら、ChatGPTやGeminiの力を借りるのがおすすめです。本稿の難しそうな部分の多くは、私自身、AIに教えてもらって扱えるようになりました。「無料のAI」「自分だけのAI」が欲しいなら、トライする価値はあると思います。