外出先の非力なノートPCで自宅の大型LLMを動かす「LM Link」登場

アクセスランキング

Special Site

PC Watch をフォローする

最新記事

Impress Watchシリーズ 人気記事

おすすめ記事

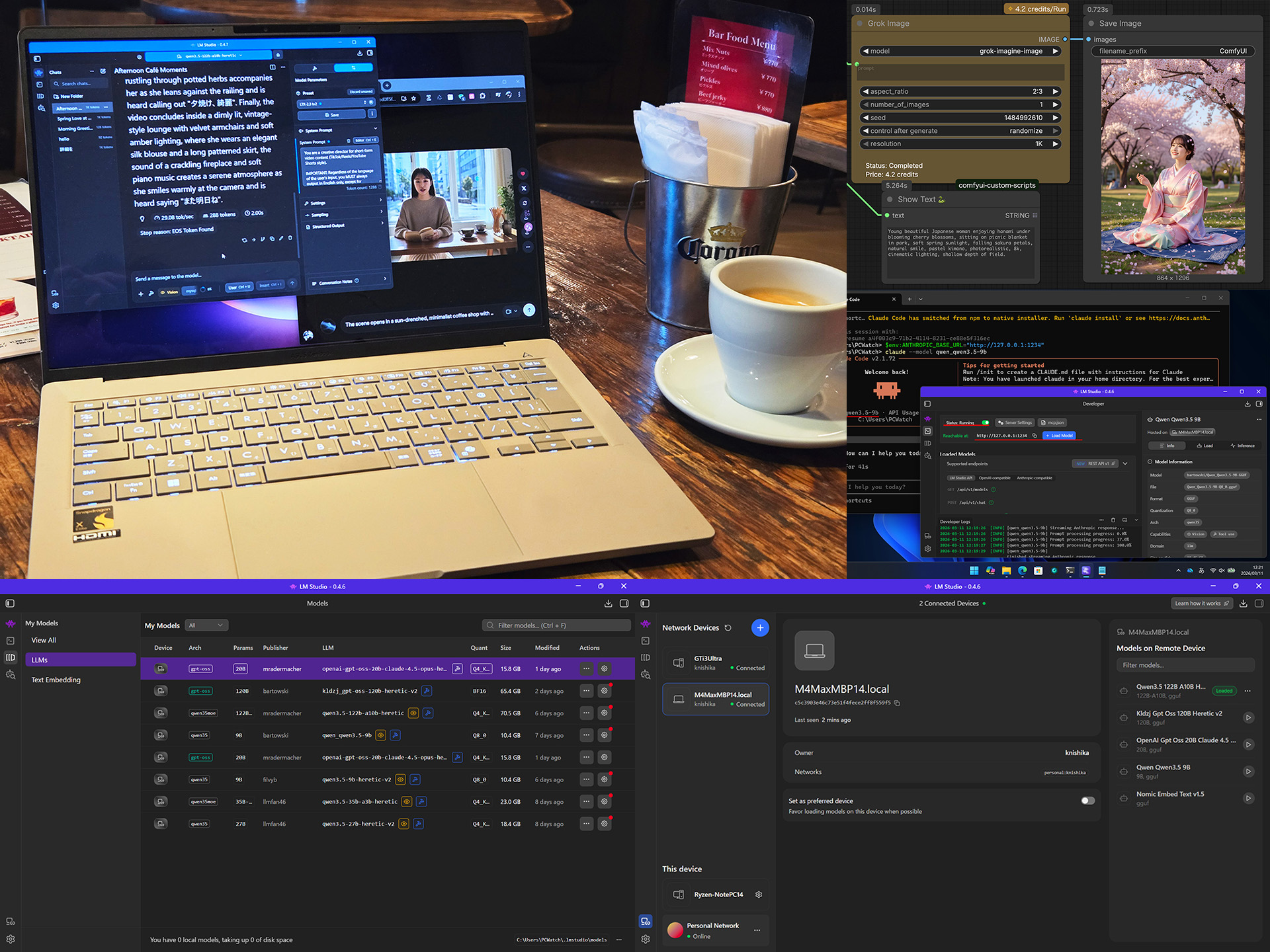

自宅で強力なデスクトップPCを使い、LM StudioでローカルLLMを楽しんでいる読者の方は多いのではないだろうか。でも、「出先から非力なノートPCでも使えれば便利なのに」……と、ほとんどの人が思うはず。これを実現したのが今回ご紹介するLM Linkだ。

LM Studioはこの連載で何度も登場しているので詳しい説明は不要だとは思うが、ローカルPC上でLLMを動かせるツールで、LLMを処理するllama.cppをGUIで使いやすくするチャットUIに、さまざまな機能を加えたアプリだ。

2026年1月末にバージョン0.4.0がリリースされ、大幅な刷新でUIなどいろいろ変わった。その後2月26日のバージョン0.4.5の新機能の1つとして、LM Linkがあった。今回改めてご紹介したい。

このLM Link、ザックリ一言で機能を説明すると、

“LM Studio上で動作しているLLMを、インターネット越しでもリモートから使えるようにする仕組み”

となる。

たとえば自宅や職場では、それなりのGPUを搭載したPCがあり、LM Studioを動かしているとする。この場合、同一LAN上に接続されたデスクトップPCやノートPCは、OpenAI API互換のエンドポイント(endpoint)を使い、Open WebUIといった別チャットアプリから接続すれば利用可能だ。ただし、同一LAN上ではないPC、たとえば外出先からだと、VPNなどを経由しない限り利用は不可能となる。

ところがこのLM Linkを使うと同一LAN上に限らず、どこからでもGPU搭載AI PCで作動するLM Studioにアクセスできるのだ。

一般的にデスクトップPCは頑張れば(笑)GPUを搭載可能であるが、ノートPCに関してはGPU搭載機は重くてかつ高価だ。とてもカフェなどで気軽に広げて使える代物ではないだろう。ところがLM Linkを使うと軽量級のモバイルノートPCでもLM Studioを出先でも使えるようになる。まさに「待ってました!」的機能だ。

仕掛け的には、lmstudio.aiにアカウントを作り、そこで接続デバイスを管理する。ただこれだとチャット内容など抜かれる可能性が?と思うだろうが、そこはTailscaleを使用(WireGuardプロトコルを基盤にしたメッシュVPNサービス)して暗号化し、デバイス同士が直接ピアツーピア接続するため心配はない。

現在は無料で利用可能となっている。制限は2ユーザー、各5デバイス(計10デバイス)まで。プレビュー終了後、追加の課金オプションを導入予定となっている。この制限だと現状、職場でというより、(職場で勝手にLM Studio使ってるケースも含め)個人利用がメインとなるだろうか。

使い方は簡単だ。最新のLM Studio(0.4.6)を起動すると、左下設定の上にLM Linkのアイコンが増えている。ちなみに、作例として挙げているPCは、現在モデルを何もダウンロードしてないので一覧には何もない。

LM Linkのアイコンがあるので、これをクリックすると、初めはlmstudio.aiのアカウント登録画面になり、Googleアカウントなどを使ってアカウントを作る。

初回ログインが終わると、LM Linkのパネルは、接続済みのPCが表示される。ここでは既に接続済みの「Beelink GTi13 Ultra」(GeForce RTX 4080 SUPER/32GB+GeForce RTX 4090/48GB)と、M4 Max 128GB搭載の「MacBook Pro 14」、そして今回接続した「Ryzen-NotePC14」が見える。

先述の通り、作例のPCでは何もモデルをダウンロードしていないが、モデル一覧にはリモートのAI PC側にある普段見慣れたモデルが表示される。これらは接続している2台のPCにあるモデルだ。

試しにQwen3.5-122b-a10bをロードすると、リモートのPCでロードが行なわれ、チャット開始できるようになる。当然、無事作動した。122bなので、100GB近くのVRAM(もしくは高速なユニファイドメモリ)を搭載していない限り動かず、一般的なモバイルノートPCでは作動不可能なのだが、しかしLM Linkを使えば、実際は接続先のAI PCが動き、入力と出力のみローカルPCを使うので、こんなことが可能となるわけだ。

いかがだろうか?LM LinkでGPU搭載PCで作動するLM Studioさえ起動しておけば、どこからでもノートPCから接続、使うことができる。VPNを使えばOpen WebUIなどから使用は可能であるが、この手軽さはLM Linkならではだ。

そうそう、ちなみにリモートのAI PCがWindows Updateで勝手に再起動したら動かなくなるのでは?という疑問があるだろう。これに関しては、設定→Developer→Enable Local LLM ServiceをONにすれば、LM Studioがサービスで起動するため、ログイン状態でなくてもLM Linkが使用可能になる。外での用途が多いケースは、このオプションをオンにして使ってみてほしい。

LM Link全体の管理は、lmstudio.aiにログインし、LM Linkのメニューから行なう。ここで接続しているPCを解除することもできる。

と、ざっとこんな感じだ。設定も簡単!そして効果抜群!ローカルLLMをもっと活用したいユーザーは、これを使わない手はないだろう。

チャットだけならLM Studio 1つで事足りるが、面白いのは、この状態でOpenAI API互換のエンドポイントも使えることだ。もちろん、リモートのAI PC側ではなく、ローカルで作動するLM Studioを利用する。これによってOpenAI API対応のほかのAIアプリもGPU非搭載な普通のローカルPCで作動するようになるわけだ。

エンドポイントを有効にするには「Developer」メニューで「Status Running」をオンにすればOK。これでOpenAI API互換のエンドポイントが使用可能になる。この時、エンドポイントは、

か、使用するアプリによっては、

としないと動かないケースもある。

まずいつもの画像生成で試してみた。筆者がやろうとしているのは、簡単なキーワードからLLMに詳細な画像生成プロンプトを作らせる、いわば「プロンプト拡張」だ。ただし、ローカルには画像生成が可能なGPUがないので、Grok Image APIを使って生成してみた。

事前にカスタムノードのcomfyui-vrgamedevgirlをインストールしておき、ComfyUIを起動。下記のようなWorkflowを準備する。

左側がエンドポイントを指定しLLMを使うVRGDG Local LLMノード。backendをopenai_compatible、base_urlをhttp://127.0.0.1:1234/v1、modelを今回はQwen3.5 9bとした。テキストは上側がユーザープロンプト、下側がシステムプロンプト。

中央下のShow Textノードは、単純に出力の表示。中央上は有料のGrok Image APIを呼び出すノード。その横が結果の画像表示。Japanese womanで衣服指定なしだと相変わらず着物になるが(笑)、それっぽい写真が生成された。

今回プロンプトは“お花見を楽しむ若い日本人美女”と簡単なので、これなら直接書いてもいいが、もっと複雑なものだと(英語が得意でない限り)手で書くのはちょっと厳しくなる。

もちろん、Show Textに出力されたプロンプトをコピー、GeminiやGrok Imagineにペーストして生成するのもOK。これであれば無料枠で何枚かは生成できるだろう。

次はClaude CodeをローカルLLMで起動してみよう。

Claude Codeは、Anthropicが提供しているターミナル(コマンドライン)ベースのAIコーディングツールで、AIにコード生成などを指示できる。

通常は同社のClaudeモデルをAPI経由で利用するが、これもLM StudioのエンドポイントがオンになっていればローカルLLMを使えるわけだ。設定は簡単。

Windowsの場合、PowerShellで、

$env:ANTHROPIC_AUTH_TOKEN="lmstudio"$env:ANTHROPIC_BASE_URL="http://127.0.0.1:1234"claude --model qwen_qwen3.5-9b※ モデルはLM Studioで認識しているものこれだけでClaude CodeがローカルLLMで起動する。

このケースだと、AI PCで作動するモデルが高性能なほど威力を発揮。Qwen3-Coder-Next(80b/3b)、Qwen3.5-27b、Qwen3.5-35b-a3b辺りは最低限使いたいところ。

最後はLM Studioのシステムプロンプトへ、簡単なキーワードから映像のシナリオを作る……といった特殊なものを入れ、プロンプト拡張として利用する例だ。LLMにはQwen3.5-122b-a10bを使用している。

以下は、出力された動画生成用プロンプトをGrok Imagineで生成しているシーンだ。

Sora2を使っていて思ったのだが、簡単なキーワードを入れるだけでAIが勝手にシーンやセリフを生成(もちろん時間指定やストーリーボードなど細かい指定もできる)、それを使って映像を出す……というのが面白かったので、これを何とか手元で再現できないか?と週末に試行錯誤したのがこのシステムプロンプトを使ったプロンプト拡張となる(笑)。

与えたキーワードはこれ。

春、桜の花が咲く季節。

週末明けの月曜日、職場にタイプのイケメン。今週も彼に会えるとワクワクな若い日本人美女OLの一日。もちろんファッションは可愛い系

実際の動画はこちらにある。尺は10秒だが、5つのシーンに自動的に割り振られセリフもいい感じだ。

上記のキーワードからこの動画の構成にするには、よほど慣れた人でない限り無理だろう。それをシステムプロンプトへルールを書くだけでこれだけの動画になるので、122bはなかなかの性能だといえよう。

(極端な例だが)これを外出先のカフェでできるのだから、LM Linkはうまく使えば、頼もしい相棒となるのは間違いなし!

なお、このシナリオ生成拡張プロンプトと最新版のLTX-2.3を使って、Sora2化する話を後日掲載する予定だ。LTX-2.3は映像だけでなく、音楽や効果音、音声も出るので、かなりそれらしい動画になる。お楽しみに!

以上のように、LM LinkはGPU搭載AI PCで作動中のLM Studioを利用して、インターネット越しでもほかのPCからリモートアクセスできる仕掛けだ。LM StudioのUIは全く同じなので戸惑うことなくシームレスに利用できる。

加えてローカルで作動するLM StudioをOpenAI APIのエンドポイントとしても使えるため、LLMを使うAI関連のアプリケーションがそのまま動いてしまうのも魅力的だ。

いずれにしても自宅(もしくは職場)でLM Studioを起動している人は、ぜひLM Linkを使いモバイルノートPCでもLM Studioを楽しんでほしい。

![Samsung製SSDが度重なる急騰で累積値上がり率300%超へ、「9100 PRO」8TBモデルは複数ショップで約55万円に [5月前半のSSD価格]](https://image.trecome.info/uploads/article/image/090f2f9e-98e5-4a0e-85d6-876d4496707d)